AI의 두 얼굴, 독이 될까 약이 될까?…빅테크의 고민

2026-03-25 13:37

인공지능(AI) 기술의 발전이 인류의 삶을 혁신할 것이라는 기대와 함께, 그 기술이 초래할 수 있는 잠재적 위험에 대한 우려도 커지고 있다. 특히 AI가 생화학 무기나 고성능 폭발물 제조 등 치명적인 목적으로 악용될 수 있다는 경고가 나오면서, 구글, 마이크로소프트, 오픈AI 등 글로벌 빅테크 기업들이 서둘러 방어선 구축에 나섰다. 이들 기업은 AI 모델이 위험한 정보를 생성하지 못하도록 막는 윤리적 가이드라인을 설계하기 위해, 거액의 연봉을 내걸고 무기 및 생화학 전문가 영입에 열을 올리고 있다.

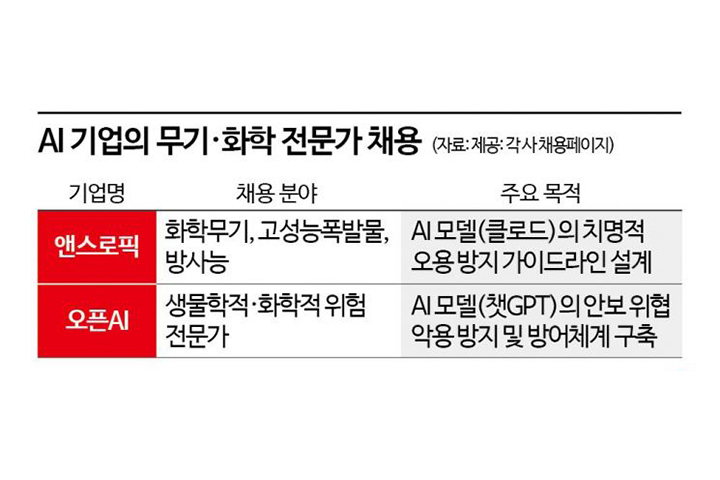

인공지능(AI) 기술의 발전이 인류의 삶을 혁신할 것이라는 기대와 함께, 그 기술이 초래할 수 있는 잠재적 위험에 대한 우려도 커지고 있다. 특히 AI가 생화학 무기나 고성능 폭발물 제조 등 치명적인 목적으로 악용될 수 있다는 경고가 나오면서, 구글, 마이크로소프트, 오픈AI 등 글로벌 빅테크 기업들이 서둘러 방어선 구축에 나섰다. 이들 기업은 AI 모델이 위험한 정보를 생성하지 못하도록 막는 윤리적 가이드라인을 설계하기 위해, 거액의 연봉을 내걸고 무기 및 생화학 전문가 영입에 열을 올리고 있다.AI 챗봇 '클로드' 개발사 앤스로픽은 최근 화학무기 및 고성능 폭발물 정책 매니저 채용 공고를 냈다. 무기 방어 분야에서 5년 이상 경력을 가진 박사급 전문가를 대상으로, 연봉은 최대 4억 원을 훌쩍 넘는다. 앤스로픽의 이러한 움직임은 'AI 시스템의 치명적인 오용 방지'를 최우선 과제로 삼고 있음을 보여준다. 과거 미 국방부와의 협력에 선을 그었던 만큼, 자사 AI 모델이 살상 무기 개발에 활용되는 것을 원천적으로 차단하겠다는 강력한 의지의 표명이다.

마이크로소프트(MS), 구글, 메타 등 다른 빅테크 기업들도 AI의 잠재적 위험성을 인지하고 관련 전문가 영입에 적극적으로 나서고 있다. 오픈AI의 최대 투자자이기도 한 MS는 이미 2023년부터 전문 레드팀을 운영하며 AI가 생화학 무기 제조법이나 규제 약물 합성 방법 등을 알려주지 못하도록 방어 체계를 시험하고 있다. 단백질 구조 예측 AI '알파폴드'를 운영하는 구글은 바이오 보안 전담팀을 두고 있으며, 앤스로픽 등과 함께 생화학 무기 관련 안전 표준을 만드는 데 협력하고 있다. 오픈소스로 모델을 공개하는 메타는 모델 배포 전 수천 개의 위험 질문을 던져 답변을 거부하도록 학습시키는 데 생화학 전문가들을 활용하고 있다.

하지만 공격 기술과 방어 기술은 항상 함께 발전하기 마련이라는 점에서, 이러한 노력이 완벽한 안전을 보장할 수는 없다는 지적도 나온다. AI 기술의 오용 가능성을 둘러싼 논쟁은 이제 시작 단계에 있으며, 기술 발전의 속도에 맞춰 윤리적, 제도적 장치를 마련하기 위한 사회적 논의가 시급한 시점이다.

기사 안민성 기자 anmin-sung@lifeandtoday.com